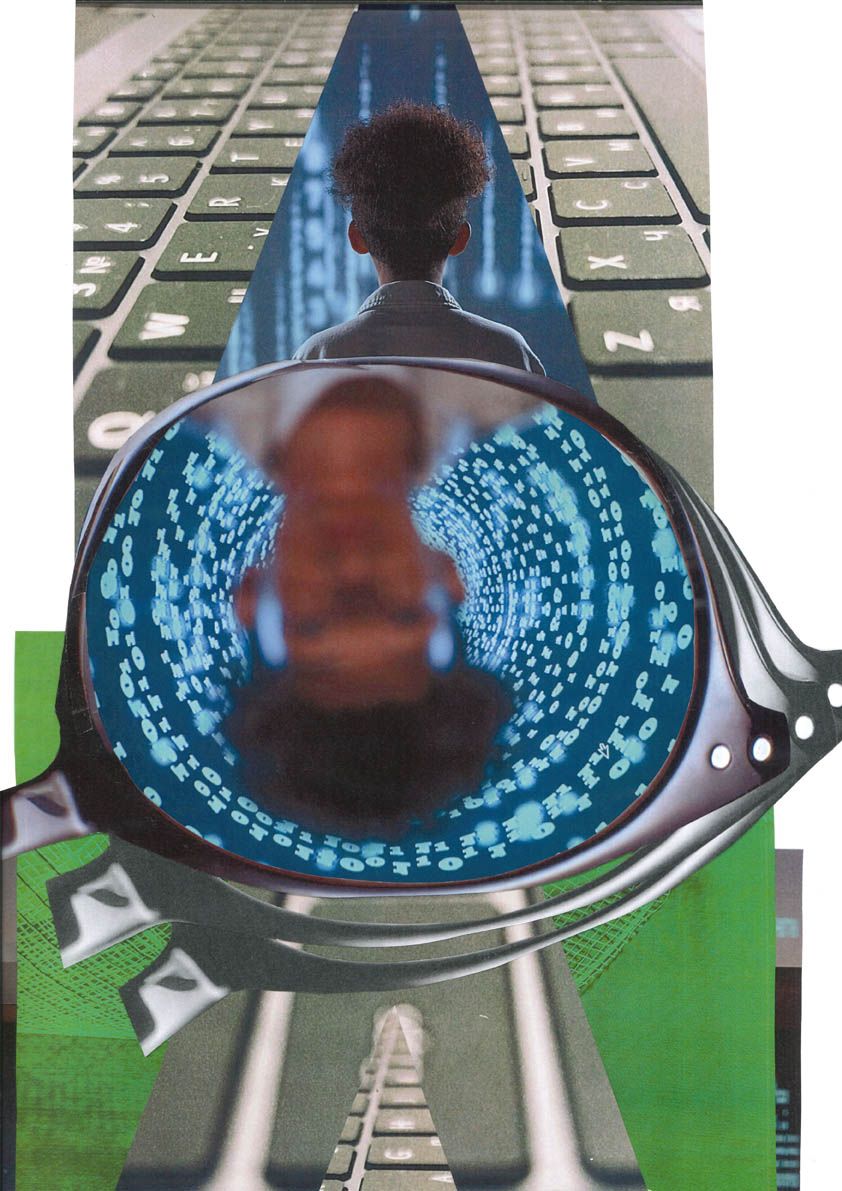

La Inteligencia Artificial (IA) parece ser el gran hito de la nueva era tecnológica. Pero surge una pregunta inevitable: ¿una nueva era para quién? ¿El futuro digital será igual para todos?

Diversas especialistas advierten que, lejos de la neutralidad prometida, existen variables críticas que pueden profundizar la brecha de género.

Imaginemos un sistema de inteligencia artificial diseñado para otorgar créditos que discrimina a las mujeres porque los datos históricos indican que poseen menos patrimonio —cuando durante décadas ni siquiera podían tenerlo por ley—. O un algoritmo de selección laboral que descarta candidatas por su edad reproductiva.

Muchos de estos sesgos ya existían en el mundo analógico. Pero cuando se trasladan a sistemas automatizados y escalables, el impacto se multiplica de forma exponencial.

Por eso, especialistas coinciden en que la verdadera autonomía de las mujeres en el siglo XXI también implica habitar y cuestionar el ámbito digital.

El debate cobra relevancia en un momento clave: mientras el mundo observa la Cumbre Global sobre Inteligencia Artificial en Seúl, la gobernanza tecnológica sigue siendo predominantemente masculina. Según el Foro Económico Mundial, solo el 22% de quienes trabajan en IA son mujeres, lo que deja las decisiones sobre el futuro digital en manos de una minoría poco diversa.

Anatomía de la IA y sus prejuicios

Para comprender cómo se construyen estos sesgos, la investigadora Milagros Miceli, especialista en la infraestructura humana de la IA en el Weizenbaum Institut de Berlín, propone mirar detrás del mito tecnológico.

Lejos de ser una mente autónoma, la inteligencia artificial es un motor estadístico que atraviesa tres etapas críticas: la recolección de datos, el etiquetado y el entrenamiento.

En la primera fase, los sistemas se alimentan de enormes volúmenes de información provenientes de internet y archivos históricos. El problema es evidente: si los datos reflejan siglos de desigualdad, el algoritmo aprenderá que esa desigualdad es la norma.

Luego llega el etiquetado de datos, una etapa fundamental donde se define qué información es válida. Miceli fue una de las primeras investigadoras en visibilizar quién realiza ese trabajo invisible.

La inteligencia artificial no aprende sola: necesita que miles de personas clasifiquen imágenes, textos y patrones para que el sistema pueda interpretarlos.

Este trabajo, conocido como “Ground Truth” o “Verdad de Terreno”, suele ser realizado por mujeres precarizadas del Sur Global, que entrenan a los algoritmos bajo condiciones laborales inestables.

Si quienes etiquetan los datos trabajan bajo presión extrema o reproducen sesgos culturales invisibles, la máquina incorporará esa mirada como una verdad absoluta.

Finalmente llega el entrenamiento: el algoritmo detecta patrones repetidos y los replica.

La lógica es simple —y peligrosa—: si históricamente los puestos de poder estuvieron ocupados por hombres, el sistema interpretará que ese es el perfil ideal para el futuro.

Así, lo que parece una decisión técnica e imparcial termina siendo una sentencia automatizada basada en la desigualdad histórica.

La dictadura de la frecuencia

“Lo que hace el algoritmo es mirar la frecuencia. No piensa: analiza la probabilidad de que algo vuelva a ocurrir porque ya ocurrió antes”, explica Mailén García, socióloga y directora de Data Género.

Ese principio estadístico explica por qué la inteligencia artificial tiende a ser conservadora: si el pasado fue desigual, el algoritmo lo reproduce.

Para García, uno de los grandes problemas es la falta de transparencia.

“Son decisiones demasiado sensibles para quedar únicamente en manos de fórmulas matemáticas, sobre todo cuando todavía existen pocos mecanismos reales para auditar los algoritmos”, advierte.

Desde Data Género trabajan para transformar los datos en herramientas de incidencia social. Un ejemplo es AymurAI, una plataforma de software libre que permite auditar decisiones judiciales vinculadas a casos de violencia de género.

El proyecto fue recientemente incluido en un libro impulsado por ONU Mujeres y el gobierno de India, que reúne 23 iniciativas globales de inteligencia artificial con perspectiva de género.

Mujeres y precarización

Pero los sesgos no solo aparecen en los resultados de la tecnología. También están presentes en su infraestructura humana.

Milagros Miceli explica que la supuesta automatización de la IA depende de miles de trabajadores invisibles.

En plataformas como Mechanical Turk de Amazon, miles de personas realizan tareas repetitivas de clasificación de datos por centavos de dólar. A este fenómeno se lo conoce irónicamente como “Inteligencia Artificial artificial”.

“No puede haber justicia algorítmica si quienes entrenan a la máquina trabajan en condiciones de vulnerabilidad”, sostiene Miceli.

Además de la precarización económica, muchas de estas trabajadoras enfrentan un alto costo emocional.

Para moderar contenidos en redes sociales, por ejemplo, deben analizar imágenes de violencia, abuso y discursos de odio durante horas, en lapsos de tiempo extremadamente breves.

Este trabajo invisible deja huellas profundas de estrés y ansiedad, mientras sostiene el funcionamiento de plataformas globales.

El mito de la neutralidad tecnológica

La idea de que una máquina es imparcial por estar basada en matemáticas es, para muchas expertas, una de las mayores trampas del debate tecnológico.

La especialista en ciberseguridad Luján Araujo explica que los datos nunca son neutrales: son reflejos de la sociedad que los produce.

“Cuando un algoritmo prefiere varones para puestos técnicos, no está siendo objetivo: está reproduciendo una inercia cultural”, afirma.

Por eso, la diversidad en los equipos que diseñan tecnología se vuelve fundamental.

Sociólogos, antropólogos y especialistas en género comienzan a participar cada vez más en el desarrollo de sistemas de datos, aportando una mirada humana a procesos que antes se consideraban puramente técnicos.

La revolución tecnológica no es solo un desafío de programación: es también un desafío cultural.

Porque si los algoritmos se diseñan sin perspectiva de género, la inteligencia artificial podría terminar reforzando las mismas desigualdades que la sociedad intenta superar.

Por eso, muchas expertas coinciden en una conclusión clara: participar, auditar y ocupar los espacios donde se decide la arquitectura digital es hoy un acto de resistencia feminista.

Solo así será posible garantizar que la revolución tecnológica no termine sellando un nuevo techo de cristal.

Ilustración: Verónica Martínez Castro.

at Malen Lesser

Accedé a los beneficios para suscriptores

- Contenidos exclusivos

- Sorteos

- Descuentos en publicaciones

- Participación en los eventos organizados por Editorial Perfil.

Comentarios